La legge di Moore è stata il faro che ha guidato il rapido sviluppo dei processori nell’ultimo mezzo secolo ma negli ultimi anni si è dimostrata ormai superata con i produttori sempre più costretti a misurarsi con i limiti fisici legati alla sempre più spinta miniaturizzazione dei transistor: La legge di Moore è ancora valida? Nature ne celebra la fine.

Jim Keller, ingegnere ex AMD e padre dei processori Ryzen, successivamente passato (aprile 2018) nelle fila di Intel per poi uscire dalla società a giugno 2020 per motivi personali aveva provato a “rianimare” la legge di Moore spostandola sul piano dei progressi compiuti dai produttori di processori sul versante delle istruzioni per ciclo di clock (IPC): La legge di Moore non è morta. Jim Keller: balzo in avanti in termini di IPC per le CPU Intel.

NVidia ha tempo osservato che la legge di Moore è ormai morta e sepolta. In occasione dell’evento GTC 2020 del 15 dicembre, svoltosi ovviamente online, Bill Dally ha ribadito il concetto.

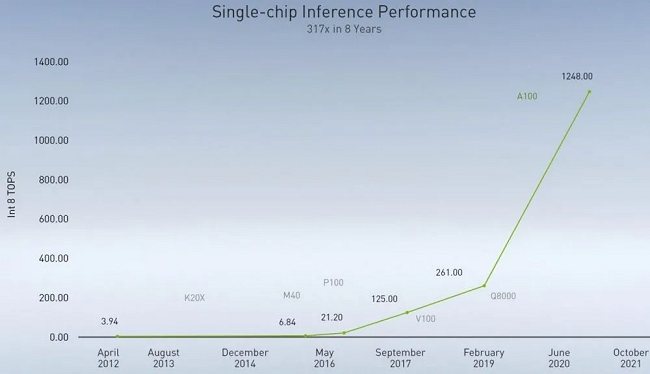

Dally, scienziato a capo del team di NVidia che si occupa della ricerca, dell’ideazione e dello sviluppo di nuove tecnologie, ha osservato che punto di riferimento per le GPU è la legge di Huang (dal nome Jen-Hsun Huang, cofondatore, presidente e CEO dell’azienda).

Cos’è la legge di Huang

La legge di Huang ha coraggiosamente previsto che le GPU avrebbero raddoppiato ogni due anni le prestazioni sul versante delle elaborazioni connesse con l’intelligenza artificiale.

Dally ha utilizzato tre progetti per descrivere come il suo team di ricerca, composto da oltre 200 persone, ha implementato con successo tale legge.

Nello specifico, NVidia ha sviluppato uno speciale strumento chiamato MAGNet ovvero un acceleratore per gli algoritmi di intelligenza artificiale che può raggiungere una velocità computazionale pari a 100 TOPS/W (100 miliardi di operazioni per watt di potenza consumata). Si tratta di un traguardo importante che durante le prime simulazioni avrebbe permesso di superare qualsiasi processore per l’intelligenza artificiale oggi disponibile.

MAGNet adotta una serie di nuove tecnologie per coordinare e controllare il flusso di informazioni attraverso il dispositivo riducendo al minimo gli scambi di dati, ciò che consuma più energia.

Gli ingegneri di NVidia hanno anche valutato l’utilizzo di un collegamento ottico molto più veloce che può sostituire le attuali soluzioni. Esso si basa su un sistema DWDM (Dense Wavelength Division Multiplexing), utilizzato ad esempio anche sulle reti di trasporto degli operatori di telecomunicazioni su fibra, che permetterà trasmissioni di dati a oltre 1 TB/s con chip da 1 nm quindi 10 volte più veloci rispetto alla tecnologia odierna.

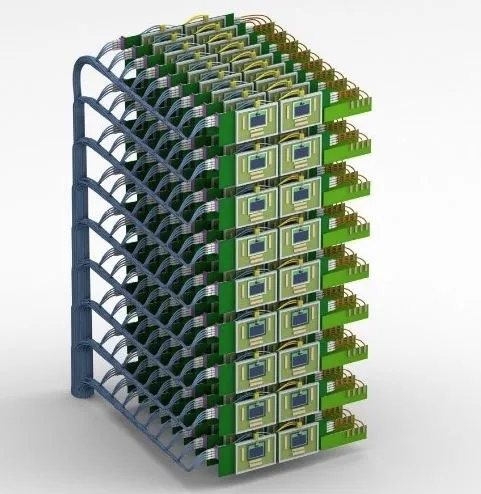

Dally ha anche mostrato un esempio del nuovo sistema NVidia DGX (nell’immagine) che può integrare più di 160 GPU con l’aiuto di questo stesso tipo di collegamento ottico.

NVidia è decisamente ambiziosa per quanto riguarda la formulazione della legge di Huang e il desiderio di rispettarla in ottica futura. Certo è che l’azienda ha investito moltissimo in termini di ricerca e sviluppo nel campo dell’intelligenza artificiale: ci si attende una crescita vorticosa nei prossimi anni.

Lo stesso Dally vanta la registrazione in proprio di oltre 120 brevetti, è stato presidente del dipartimento di informatica dell’Università di Stanford prima di entrare a far parte di NVidia nel 2009. Attualmente è a capo della ricerca NVidia per quanto riguarda intelligenza artificiale, ray-tracing e networking ad alta velocità.

Vale inoltre la pena ricordare che NVidia ha recentemente acquisito ARM con una mossa che permetterà alla società di Huang di fare la parte del leone anche sui SoC.

/https://www.ilsoftware.it/app/uploads/2023/05/img_22291.jpg)

/https://www.ilsoftware.it/app/uploads/2023/06/OpenAI-Logo-GPT-ChatGPT-IA-min.jpg)

/https://www.ilsoftware.it/app/uploads/2025/04/flux_image_475760_1744976324.jpeg)

/https://www.ilsoftware.it/app/uploads/2024/07/chip-IA-openai.jpg)

/https://www.ilsoftware.it/app/uploads/2025/04/grok-lg-ai-emotiva-pubblicita.jpg)