/https://www.ilsoftware.it/app/uploads/2023/05/img_17343.jpg)

Già da diversi anni Google è impegnata a sviluppare le sue soluzioni per l’intelligenza artificiale e oggi l’azienda comincia a mostrare i primi risultati dei suoi sforzi pluriennali. Ad esempio Duplex è uno dei servizi più avanzati che sia mai stato concepito dai tecnici della società di Mountain View (vedere Google Duplex, l’assistente digitale può chiamare direttamente ristoranti ed esercizi commerciali).

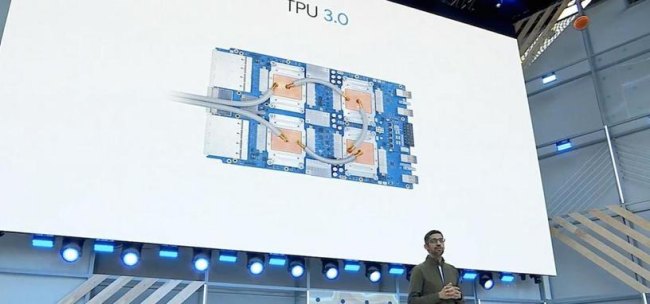

Esattamente a un anno di distanza dalla presentazione della versione precedente (Chip TPU di Google, cos’è. Ecco la seconda generazione per spingere sull’intelligenza artificiale), Google mostra il nuovo chip TPU 3.0.

Acronimo di Tensor Processing Unit, i chip TPU sono chiamati ad assolvere compiti ben precisi e rivestono un ruolo essenziale nello sviluppo di progetti basati sull’utilizzo di reti neurali. Essi sono ASIC (application specific integrated circuit), quindi tutt’altro che general purpose, progettati per il calcolo tensoriale (i tensori sono entità algebriche adoperate nelle applicazioni di intelligenza artificiale) a 8 bit, più che sufficienti per questo specifico tipo di elaborazioni.

Google TPU 3.0 raddoppia abbondantemente le prestazioni della versione precedente passando da 45 TeraFLOPS a più di 350 TeraFLOPS.

Abbinando 64 chip di nuova generazione, Google può sviluppare una potenza di calcolo pari a qualcosa come 100 PetaFLOPS (ovvero 100.000 TeraFLOPS) contro gli 11,5 PetaFLOPS dei TPU 2.0.

I nuovi modelli di TPU devono però essere inseriti all’interno di rack con raffreddamento a liquido dal momento che il calore da dissipare sembra essere cresciuto in maniera rilevante rispetto alla versione dello scorso anno.

La seconda versione dei chip TPU era stata messa a disposizione degli sviluppatori di tutto il mondo attraverso la piattaforma Google Cloud e in particolare facendo leva sul Google Compute Engine. Anche i chip TPU 3.0 seguiranno lo stesso percorso con l’installazione presso i data center dell’azienda che è prevista per i prossimi mesi.

/https://www.ilsoftware.it/app/uploads/2025/04/SoC-intel-automotive.jpg)

/https://www.ilsoftware.it/app/uploads/2023/07/Adobe-Firefly-logo-IA-generativa-immagini-min.jpg)

/https://www.ilsoftware.it/app/uploads/2025/04/rayban-meta-occhiali-smart.jpg)

/https://www.ilsoftware.it/app/uploads/2023/08/YouTube-Logo.png)