Quando si interpella un chatbot come ChatGPT, Claude, Perplexity, Cerebras Inference, Phind e così via, si interagisce con un Large Language Model (LLM) precedentemente addestrato su un volume di informazioni variabile, di diversa qualità e provenienza. NotebookLM è un innovativo strumento sviluppato da Google e basato sull’intelligenza artificiale che si adatta alle specifiche esigenze specifiche di ciascun utente, utilizzando documenti, note e appunti come base per l’addestramento del modello.

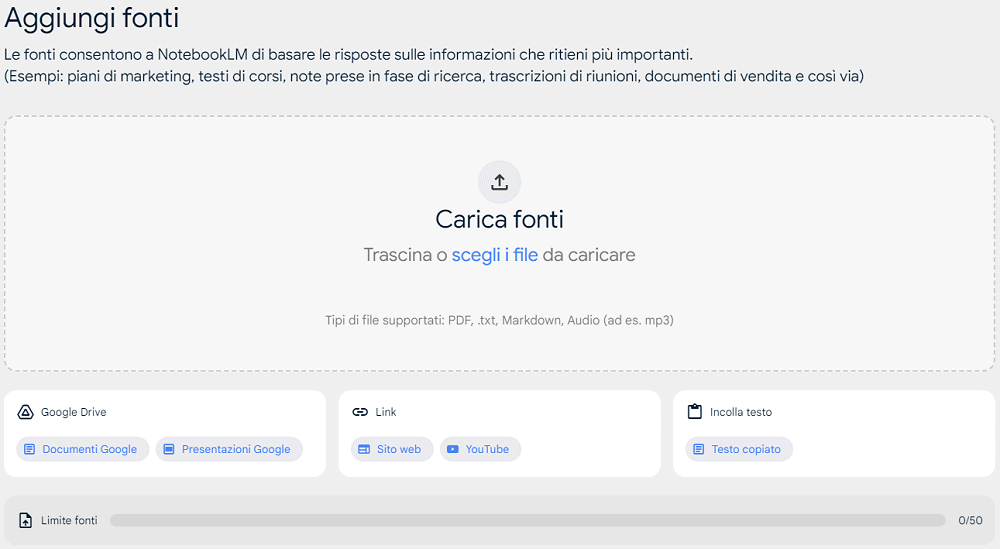

Uno strumento come NotebookLM prende in input documenti PDF, testi in formato .txt, documenti Markdown, ma anche semplicemente contenuti copiati e incollati (CTRL+C, CTRL+V). Può attingere al contenuto dell’account Google Drive dell’utente, utilizzare come sorgenti le presentazioni Google, i video pubblicati su YouTube, ma anche link a siti Web e file audio in formato MP3.

Cosa significa tutto questo? Che il motore multimodale di NotebookLM può unire le informazioni provenienti da più fonti per “istruire” il sottostante LLM e rispondere a precise domande dell’utente.

Come funziona NotebookLM e per cosa può essere utile

È vero che oggi è possibile sottoporre un testo ai migliori chatbot basati sull’intelligenza artificiale e, ad esempio, ottenerne un riassunto. NotebookLM, tuttavia, straccia tutti per potenzialità e semplicità d’uso. L’applicazione Web di Google (è fruibile da browser e non necessita d’installazione) aiuta gli utenti a gestire e comprendere le informazioni all’interno dei propri documenti.

Come accennato nell’introduzione, NotebookLM permette il caricamento di diversi tipi di file, come PDF, documenti di testo e persino note scritte a mano. I prompt, ossia le richieste avanzate a NotebookLM, possono essere in italiano, e ciò indipendentemente dalla lingua in cui i testi sono scritti.

Per fare un esempio concreto: immaginate di passare a NotebookLM la registrazione di un’intervista raccolta in inglese e salvata come file MP3. Lo strumento Google effettua il riconoscimento vocale dell’intero contenuto e permette all’utente di ottenere un riassunto del contenuto, una trascrizione fedele o un componimento che evidenzi i punti salienti.

È possibile fare la stessa cosa con uno o più video YouTube, con i documenti PDF, con il contenuto di pagine Web pubbliche (non protette quindi tramite paywall o altri sistemi di accesso condizionato).

Caricare documenti e materiale su NotebookLM e parlare con il chatbot

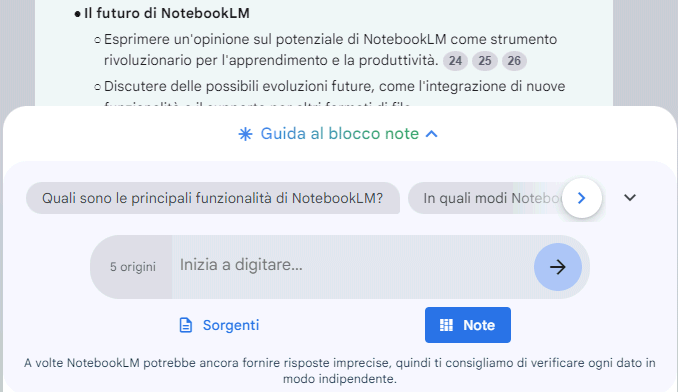

L’avventura in NotebookLM comincia dalla pagina principale del progetto: cliccando su Nuovo blocco note, si accede a una sorta di raccoglitore di documenti e materiali. Qui si possono inserire riferimenti ai contenuti che NotebookLM deve elaborare e utilizzare per rispondere alle domande poste attraverso il campo Inizia a digitare, posto nella parte inferiore della schermata.

Già caricando il primo contenuto, NotebookLM fornisce un riassunto indicando gli aspetti più rilevanti e proponendo una serie di domande “preconfezionate”, utili ad approfondire i temi trattati. Utilizzando il tasto “+” nella colonna di sinistra, si possono aggiungere altre origini ossia altro materiale che NotebookLM può utilizzare per creare contenuti. Al momento in cui scriviamo, NotebookLM supporta fino a 50 documenti, nei diversi formati.

I vantaggi di NotebookLM

Il principale beneficio derivante dall’uso di NotebookLM consiste, evidentemente, nella possibilità di riassumere documenti complessi, composti da decine o centinaia di pagine, estrapolando i punti chiave e creando schemi.

L’utilizzo di prompt efficaci, ovvero di richieste ben strutturate e argomentate, aiuta a ottenere risposte pertinenti e ben congegnate. Un ricercatore può quindi farsi aiutare dall’intelligenza artificiale per recuperare le informazioni che gli servono per la sua attività, senza essere costretto a leggere volumi di testo di lunghezza assolutamente improponibile.

Grazie a NotebookLM si possono generare contenuti in maniera automatica: a partire dai documenti caricati, l’IA può produrre FAQ, briefing, guide, estrapolare spunti, idee e parole chiave.

Il potenziale di questo strumento va quindi ben oltre l’apprendimento, tanto che NotebookLM si propone come un tool oggi sempre più indispensabile per studenti, ricercatori e professionisti che desiderano approfondire e organizzare le proprie conoscenze.

Diversamente rispetto ad altri strumenti concorrenti, NotebookLM ha il grande vantaggio di inserire riferimenti espliciti alle fonti utilizzate in ciascun testo prodotto. Ciò significa che, indipendentemente dalla tipologia della sorgente, NotebookLM indica esplicitamente su quali fonti si è basato per generare una frase o un paragrafo, quindi derivare qualche tipo di “riflessione” o conclusione.

Inoltre, basandosi sul LLM multimodale Google Gemini, NotebookLM è capace di “interpretare” immagini, tabelle e grafici: si possono quindi porre domande anche sul contenuti di questi elementi contenuti nei documenti.

Le limitazioni di NotebookLM

Presentati i tanti vantaggi di NotebookLM, va detto che come tutti gli altri strumenti basati sull’intelligenza artificiale, anche quello realizzato da Google è tutt’altro che infallibile. È perciò fondamentale mantenere un atteggiamento critico rispetto ai contenuti prodotti, non dando per scontato nulla. Il problema delle allucinazioni è sempre dietro l’angolo: anche NotebookLM può inventarsi di sana pianta testi mai scritti, dando autorevolezza alle informazioni prodotte. La cautela è quindi d’obbligo.

Ciascun utente Google può creare quanti notebook vuole, eventualmente dividendoli per argomento. Abbiamo detto che ciascun blocco note di NotebookLM può contenere fino a 50 fonti: l’utente è chiamato ad aggiornare eventuali link esterni perché lo strumento Google estrapola le informazioni nel momento in cui esse sono caricate. In altre parole, non tiene conto degli eventuali successivi aggiornamenti degli stessi contenuti.

NotebookLM supporta inoltre documenti con un massimo di 500.000 parole per sorgente. Ma le dimensioni non sono un problema perché di fatto ogni singola fonte può essere un testo lungo oltre 1.500 pagine.

Uno svantaggio non da poco sembra ad oggi essere la velocità di elaborazione delle informazioni. Certamente, soprattutto nel caso dei contenuti che devono essere recuperati da server remoti, incide anche la latenza nel richiedere e trasferire tali informazioni. Dal punto delle performance, però, Cerebras Inference resta imbattibile, con le sue risposte fulminee.

Credit immagine in apertura: iStock.com – Khanchit Khirisutchalual

/https://www.ilsoftware.it/app/uploads/2024/10/notebooklm-come-usarlo-a-cosa-serve.jpg)

/https://www.ilsoftware.it/app/uploads/2025/04/SoC-intel-automotive.jpg)

/https://www.ilsoftware.it/app/uploads/2023/07/Adobe-Firefly-logo-IA-generativa-immagini-min.jpg)

/https://www.ilsoftware.it/app/uploads/2025/04/rayban-meta-occhiali-smart.jpg)

/https://www.ilsoftware.it/app/uploads/2023/08/YouTube-Logo.png)