Il cambiamento climatico è una sfida complessa che richiede azioni collettive e razionali. La demonizzazione dei Large Language Models (LLM), i “motori” delle moderne soluzioni di intelligenza artificiale, non solo è scientificamente infondata, ma distrae dagli interventi cruciali necessari per liberare dal carbonio (decarbonizzazione) il nostro sistema energetico. Un approccio basato sui numeri, che consideri sia l’impatto che l’utilità delle attività, è fondamentale. In definitiva, però, quanto pesano davvero ChatGPT e soci in termini di sostenibilità ambientale?

Le emissioni collegabili a ChatGPT

Molte delle affermazioni che circolano sul tema dell’impatto ambientale di ChatGPT, dei LLM che ne governano il suo funzionamento e degli altri prodotti concorrenti, sono spesso fuorvianti o mal interpretate. Tra le “accuse ricorrenti” nei confronti di ChatGPT vi sono le segutenti:

- Ogni prompt inviato a ChatGPT ha un impatto ambientale 10 volte maggiore rispetto a una ricerca su Google.

- Una ricerca con ChatGPT porta al consumo di 500 mL di acqua.

- ChatGPT ha un consumo energetico giornaliero paragonabile a quello di 20.000 famiglie; un consumo di acqua quotidiano equivalente a 200 piscine olimpioniche.

- L’addestramento di un modello AI fa registrare emissioni comparabili con quelle di 200 voli da New York a San Francisco.

L’unico dato errato è il consumo di acqua per ogni ricerca: non si tratta di 500 mL per ogni interazione, ma per ogni 20-50 prompt. Gli altri numeri, sebbene tecnicamente accurati, mancano di contesto e possono generare una percezione distorta dell’impatto ambientale dei LLM. Vediamo perché.

Priorità, emissioni e utilità

Negli ultimi anni, il movimento per il clima ha compreso l’importanza di concentrarsi su cambiamenti sistemici, come la transizione alle energie rinnovabili, piuttosto che su azioni individuali. Come osserva Andy Masley nella sua analisi, focalizzarsi sulle emissioni dei LLM rischia di sviare l’attenzione da quello che rappresenta il vero problema: un sistema energetico ancora troppo dipendente dai combustibili fossili.

Promuovere azioni a basso impatto, come evitare di usare i LLM, non porta benefici significativi. Cambiamenti più incisivi, come l’adozione di sistemi di riscaldamento sostenibili o la promozione del trasporto pubblico, hanno un impatto molto maggiore.

I LLM sono strumenti potenti che possono migliorare la produttività, l’educazione e la ricerca. Ridurre il loro uso senza un’analisi delle alternative potrebbe comportare una perdita di valore sociale e scientifico. L’impatto positivo dei LLM non può insomma essere ignorato.

Inoltre, è certamente vero che il raffreddamento dei data center richiede risorse idriche, ma ciò non è un problema esclusivo dell’intelligenza artificiale: coinvolge tutti i dispositivi tecnologici. È quindi essenziale affrontare la questione nel contesto più ampio dell’efficienza e della sostenibilità tecnologica.

L’efficacia dei LLM

I LLM si distinguono per la loro abilità nel rispondere a domande complesse e offrire spiegazioni dettagliate, spesso più rapidamente rispetto alle tradizionali ricerche su Google o alla consultazione di altre fonti. Attraverso esperimenti con prompt specifici, come la richiesta di generare riassunti di testi tecnici o risposte strutturate, emerge l’efficacia dei LLM come strumento di apprendimento.

Nonostante le limitazioni che certamente esistono, i LLM superano la qualità di molte risorse online meno affidabili, come contenuti video o articoli non approfonditi. Questi preziosi strumenti possono ad esempio fornire una sintesi rapida su temi tecnici, risparmiando tempo e migliorando la comprensione.

Quanta energia consuma davvero ChatGPT?

Le critiche riguardanti le emissioni dei LLM spesso si concentrano su confronti impropri con altre attività quotidiane. Per esempio, una singola ricerca su ChatGPT consuma circa 3 Wh, dieci volte l’energia necessaria per una ricerca su Google (0,3 Wh). Tuttavia, in termini pratici, questa differenza equivale a lasciare acceso un orologio digitale per tre ore o inviare due email, un impatto trascurabile rispetto ad attività più energivore come lo streaming video.

Masley cita anche un esempio estremo: ipotizzando di sostituire tutte le ricerche globali su Google “trasformandole” in prompt inviati a ChatGPT, l’aumento della domanda energetica globale sarebbe quantificabile in solo l’1%. Il dato mette in prospettiva la reale portata dell’impatto ambientale dei LLM rispetto alla loro utilità.

In precedenza abbiamo detto che in molti articoli si fa presente come ChatGPT consumi ogni giorno energia equivalente a quella necessaria per le attività quotidiane di 20.000 famiglie. Ancora una volta, il dato può sembrare un numero significativo se considerato isolatamente, ma acquisisce un senso diverso quando confrontato con altre attività digitali di massa e valutato in relazione ai benefici prodotti.

ChatGPT: energia e utilità

Con 300 milioni di utenti giornalieri e un miliardo di messaggi prodotti quotidianamente, il rapporto tra energia consumata e valore prodotto da ChatGPT è notevole.

ChatGPT fornisce un servizio che soddisfa una domanda crescente in molti ambiti, dal supporto educativo al miglioramento dell’accessibilità tramite applicazioni come Be My Eyes. Si tratta di esempi virtuosi di come il digitale possa essere sfruttato per moltiplicare il valore creato rispetto alle risorse consumate, spiega ancora Masley.

L’addestramento di GPT-4, uno dei modelli generativi sviluppati da OpenAI, è un processo massivo che non avviene in modo ricorrente. L’energia utilizzata per addestrare il modello, circa 60 GWh, è distribuita su miliardi interazioni successive. Fino ad oggi, con circa 200 miliardi di “ricerche”, il costo energetico del training si traduce in un incremento di appena 0,3 Wh per ricerca, un valore trascurabile rispetto ai benefici generati.

Masley ha confrontato il consumo energetico di ChatGPT con altri servizi online:

| Servizio | Consumo Energetico (Famiglie) |

|---|---|

| Google Maps | 11.000 |

| ChatGPT | 20.000 |

| Fortnite | 23.000 |

| Zoom | 150.000 |

| Spotify | 200.000 |

| Netflix | 800.000 |

| YouTube | 1.000.000 |

Mentre ChatGPT utilizza energia pari a quella richiesta da una comunità di ridotte dimensioni, servizi come Netflix consumano oltre 40 volte di più. Inoltre, il consumo energetico di piattaforme come Spotify e Netflix è compensato dalla loro capacità di sostituire processi fisici, come la distribuzione di CD o DVD, riducendo complessivamente l’impatto ambientale.

Consumo di acqua e LLM

L’impiego di acqua per gestire il funzionamento dei LLM ha sollevato interrogativi sulla sostenibilità dell’intelligenza artificiale e sull’impatto ambientale dei data center.

Le infrastrutture che garantiscono il perfetto funzionamento di ChatGPT, degli altri chatbot e, in generale, dei LLM, poggiano su sistemi di raffreddamento per mantenere le GPU e gli altri apparati a temperature ottimali.

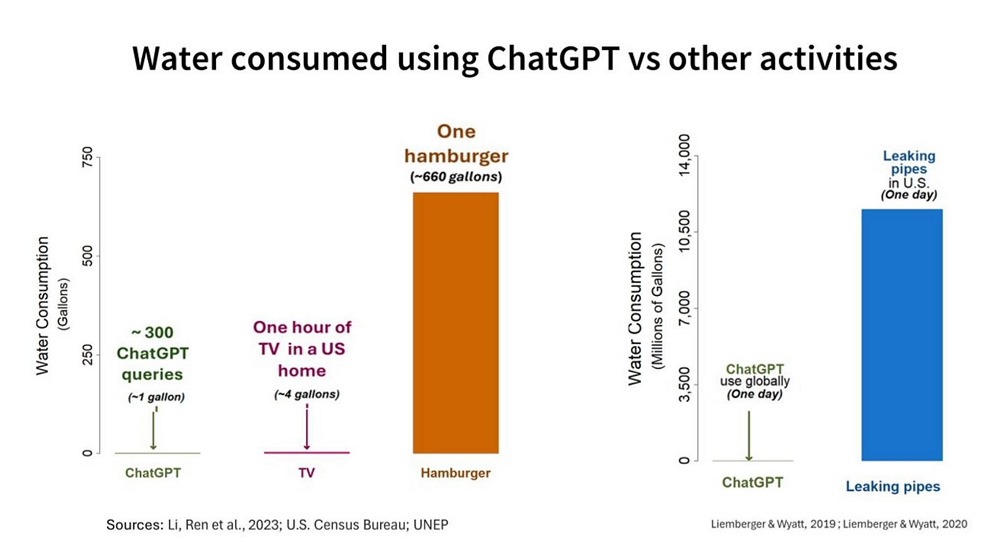

Fonte: Andy Masley su dati pubblici

Sebbene il consumo idrico di un LLM sia significativo, rimane una frazione rispetto a quello richiesto dall’agricoltura animale. Ad esempio, l’acqua necessaria per produrre un solo hamburger è equivalente a 2.300 litri, un consumo sproporzionato rispetto ai 300 litri necessari per 1.000 query ChatGPT!

Ecco una stima dell’acqua usata per condurre diverse attività digitali:

- 10 mL: invio di un’email.

- 30 mL: invio di una query a ChatGPT.

- 1.720 mL: un’ora di videochiamata su Zoom.

- 2.580 mL: 10 minuti di streaming video in 4K

In definitiva, l’utilizzo di LLM rappresenta una minima parte del consumo globale di acqua e non dovrebbe essere il focus principale per chi desidera ridurre l’impatto ambientale.

Un approccio più efficace dovrebbe invece concentrarsi sulla riduzione del consumo di carne e dei prodotti di origine animale, il supporto di politiche volte a una gestione sostenibile delle risorse idriche locali, lo sviluppo di data center in aree con risorse idriche stabili.

Credit immagine in apertura: iStock.com – Anastasiia Voronina

/https://www.ilsoftware.it/app/uploads/2025/01/chatgpt-impatto-ambientale-consumo-acqua.jpg)

/https://www.ilsoftware.it/app/uploads/2025/02/avatar-video-ai-synthesia.jpg)

/https://www.ilsoftware.it/app/uploads/2024/02/figure-01-robot-umanoide.jpg)

/https://www.ilsoftware.it/app/uploads/2024/09/era-intelligenza-artificiale-sam-altman.jpg)

/https://www.ilsoftware.it/app/uploads/2024/12/Veo-Google.jpg)